Um alto funcionário do Pentágono afirmou na quinta-feira que a Anthropic poderá enfrentar não apenas a perda de contratos, mas também o risco de ser classificada como um risco para a cadeia de suprimentos.

Autoridades do Pentágono também avaliam invocar a Lei de Produção de Defesa (Defense Production Act) para obrigar a empresa a atender às exigências das Forças Armadas, que incluem controle total de sua tecnologia de inteligência artificial para uso em operações militares, segundo fontes ouvidas pela CBS News.

A empresa recebeu um contrato de US$ 200 milhões do Pentágono em julho para desenvolver capacidades de IA voltadas ao fortalecimento da segurança nacional dos Estados Unidos.

De acordo com fontes, a Anthropic tem solicitado repetidamente que as autoridades de defesa concordem com salvaguardas que impeçam seu modelo de IA, chamado Claude, de ser utilizado para vigilância em massa de cidadãos americanos.

Autoridades do governo Trump afirmaram que esse tipo de vigilância é ilegal e que o Pentágono atua em conformidade com a lei. Também disseram que os militares buscam apenas uma licença para utilizar a IA estritamente em atividades legais.

O CEO da Anthropic, Dario Amodei, também quer garantir que o Claude não seja usado pelo Pentágono para decisões finais de seleção de alvos em operações militares sem envolvimento humano, segundo uma fonte familiarizada com as negociações. A fonte afirmou que o sistema não é imune a “alucinações” e não é suficientemente confiável para evitar erros potencialmente letais, como uma escalada não intencional ou falhas de missão sem o julgamento humano.

Em uma reunião no Pentágono na manhã de terça-feira, Pete Hegseth teria dado a Amodei até o fim desta semana para apresentar aos militares um documento assinado concedendo acesso total ao modelo de inteligência artificial, segundo fontes com conhecimento do assunto.

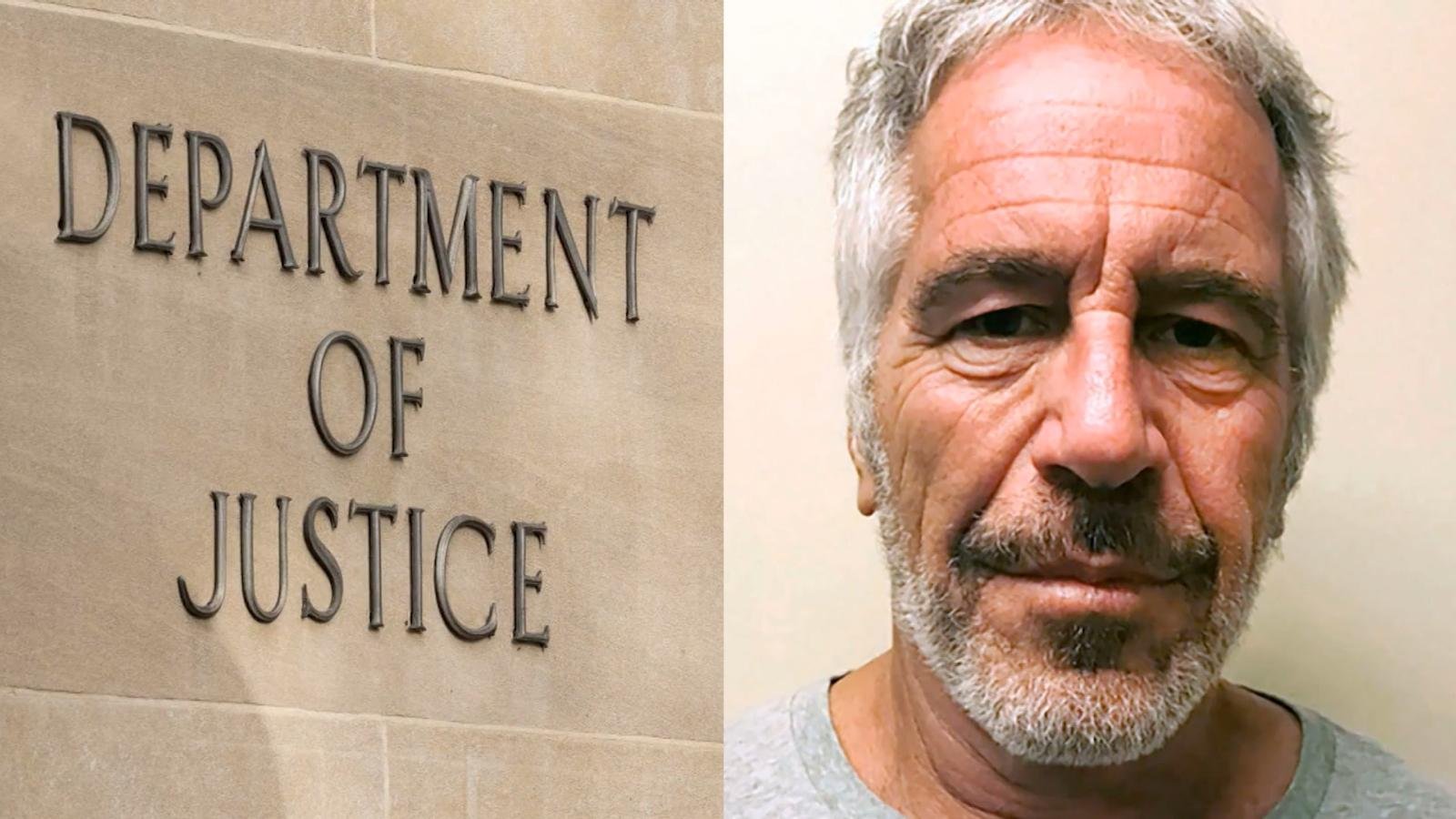

Foto: CNN